Οι ψευδείς ειδήσεις εξελίσσονται ακολουθώντας την πορεία της προηγμένης τεχνολογίας και όπως όλα δείχνουν σύντομα δεν θα πιστεύουμε ό,τι βλέπουμε.

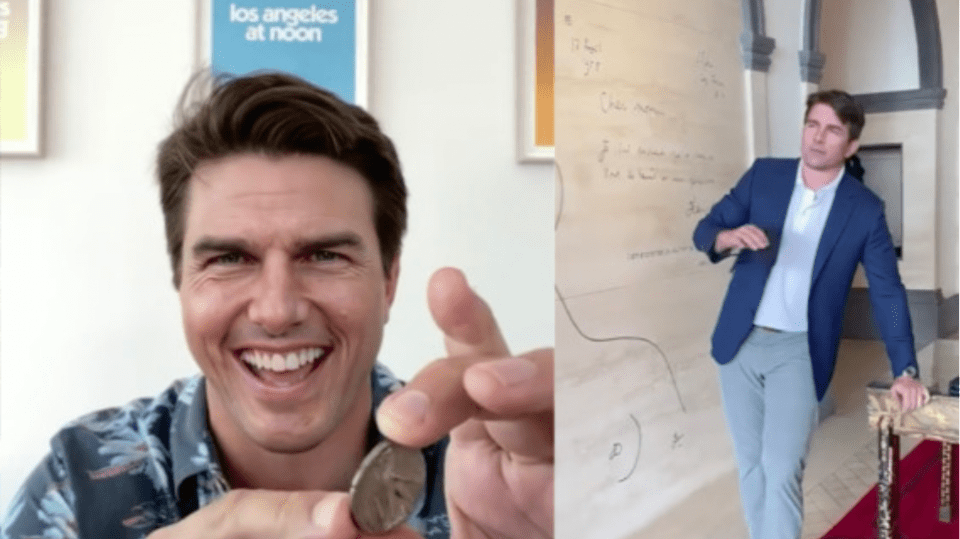

Την περασμένη εβδομάδα έκαναν το γύρο του Διαδικτύου τρία βίντεο που αναρτήθηκαν στην πλατφόρμα TikTok και φαίνεται να δείχνουν τον Αμερικανό ηθοποιό Τομ Κρουζ να κάνει κάποια αποτυχημένα ταχυδακτυλουργικά κόλπα, να παίζει γκολφ και να μιλάει για τη συνάντησή του με τον Μιχαήλ Γκορμπατσόφ.

Στα βίντεο που αναρτήθηκαν στο λογαριασμό @deeptomcruz και συγκέντρωσαν περισσότερες από 11 εκατομμύρια προβολές, ακούγεται η φωνή του ηθοποιού, οι κινήσεις του προσώπου και του σώματος δείχνουν φυσικές και ταιριάζουν στο «προφίλ» του Κρουζ, ωστόσο δεν είναι αυτός που εμφανίζεται στα κλιπ.

Πρόκειται για στιγμιότυπα που δημιουργήθηκαν με την τεχνολογία «deepfake» (βαθύ ψέμα) και δίνουν μια γεύση των δυνατοτήτων του εργαλείου. Οι ειδικοί του χώρου χαρακτήρισαν τα βίντεο «αριστουργηματικά δείγματα της συγκεκριμένης τεχνολογίας». Το «deepfake» επιστρατεύει σύγχρονες τεχνικές και αλγόριθμους της τεχνητής νοημοσύνης ώστε να τροποποιήσει το περιεχόμενο που εμφανίζεται, αντικαθιστώντας το από ένα άλλο. Οι ειδικοί έχουν εκφράσει την ανησυχία τους για την ευρεία χρήση της τεχνικής, καθώς το αποτέλεσμα είναι εξαιρετικά ρεαλιστικό και εκτός από ψυχαγωγικούς λόγους -όπως στα βίντεο του Τομ Κρουζ- μπορεί να χρησιμοποιηθεί σε «σκοτεινούς» σκοπούς.

Ηδη, η τεχνολογία «deepfake» χρησιμοποιήθηκε στην πολιτική σκηνή. Στο Διαδίκτυο κυκλοφορούν βίντεο όπου πολιτικοί προχωρούν σε τοποθετήσεις που στην πραγματικότητα δεν έχουν κάνει ποτέ, παραπλανώντας το κοινό ή δημιουργώντας εσφαλμένη εικόνα των γεγονότων. Οι ειδικοί σημειώνουν πως μέχρι να εξακριβωθεί η γνησιότητα ενός τέτοιου βίντεο, μπορεί να υπονομεύσει τη φήμη ενός υποψηφίου. Τονίζουν, δε, πως είναι ένα ισχυρότατο εργαλείο για όσους θέλουν να διασπείρουν ψευδείς ειδήσεις για να επηρεάσουν εκλογική διαδικασία. Οι ερευνητές εργάζονται ώστε να δημιουργήσουν συστήματα τεχνητής τεχνολογίας που θα μπορούν αυτομάτως να αναγνωρίσουν τα «deepfake» και η facebook ξεκίνησε το 2019 διαγωνισμό για να βρει τα καλύτερα. Προς το παρόν όμως, οι κορυφαίοι μπορούν να εντοπίσουν μόνο το 65% των ψεύτικων κλιπ.

Οι ειδικοί, πάντως, σημειώνουν πως τα «deepfakes» δεν αποτελούν επί του παρόντος σημαντικό παράγοντα στις προσπάθειες παραπληροφόρησης, καθώς απαιτούνται ειδικές δεξιότητες, εκπαίδευση υψηλού κόστους, πολλές πληροφορίες και εξάσκηση.

Η τάση είναι αυξητική, καθώς από το 2019 ο αριθμός των «deepfakes» αυξήθηκε από 14.678 σε 145.227, σύμφωνα με το ινστιτούτο ερευνών Forrester, ενώ το εκτιμώμενο κόστος από τις απάτες που προκαλούν έφτασε τα 250 εκατομμύρια δολάρια από τον Οκτώβριο του 2019 ως το τέλος του 2020.

H γενεαλογική ιστοσελίδα «MyHeritage» παρουσίασε ένα εργαλείο με τεχνολογία «deepfake» που επιτρέπει να «ζωντανεύουν» τα πρόσωπα συγγενών (ενδεχομένως νεκρών) σε παλιές φωτογραφίες. H εταιρία αναγνωρίζει πως το «Deep Nostalgia», όπως ονομάζεται το εργαλείο, μπορεί να φανεί μακάβριο σε κάποιους, ωστόσο άλλοι ίσως το βρουν «μαγικό».

Η «MyHeritage» υπογραμμίζει πως εσκεμμένα απέφυγε να εισαγάγει ομιλία, προκειμένου να αποτρέψει την κατάχρηση του εργαλείου, όπως τη δημιουργία «deepfake» βίντεο ζωντανών ανθρώπων. Στην ιστοσελίδα του «MyHeritage», ιστορικές μορφές όπως η βασίλισσα Βικτώρια και η Φλόρενς Νάιτινγκεϊλ «ζωντανεύουν», ενώ πρόσφατα αναρτήθηκε και ένα βίντεο τέτοιας τεχνολογίας του Αβραάμ Λίνκολν από την εταιρία στο YouTube.